AI-Modelle — Kapwing

Entdecke die AI-Modelle hinter Kapwings kreativen Workflows

Warum Kapwing mehrere AI-Modelle nutzt

Jede kreative Aufgabe passt zu einem anderen AI-Modell

Kein einzelnes KI-Modell ist bei jeder kreativen Aufgabe das Beste. Einige Modelle sind für realistische Bewegungen und kinematografische Kontinuität ausgelegt, andere konzentrieren sich auf Geschwindigkeit, Kosteneffizienz, Animation oder Transformationsaufgaben wie Bearbeitung und Übersetzung.

Kapwing AI kombiniert mehrere erstklassige generative Modelle, um sicherzustellen, dass jede Phase des kreativen Prozesses die am besten geeignete zugrunde liegende Technologie nutzt. Anstatt Creator in ein One-Model-Fits-All-System zu zwingen, nutzt Kapwing je nach Aufgabe unterschiedliche Modelle.

Dieser modellunabhängige Ansatz ermöglicht es Creatorn, von schnellen Fortschritten in generativer KI zu profitieren, ohne die Komplexität hinter jedem Modell verstehen oder verwalten zu müssen. Wenn neue Modelle entstehen und bestehende sich verbessern, kann Kapwing sie dort einführen, wo sie echten kreativen Mehrwert bieten.

.webp)

In Kapwing verfügbare KI-Videogenerierungsmodelle

Realistische Bewegungen, mehrteilige Szenen und visuell konsistente Charaktere

Wan 2.2

Wan 2.2 bewältigt eine breite Palette von Videostilen und ist ein starker Allrounder für Creator, die mehrere Variationen generieren, verschiedene Stile testen oder große Mengen an B-Roll mit kostengünstigen Iterationen produzieren müssen

Veo 3

Entwickelt für hochwertige Videogenerierung mit präziser visueller Kontrolle. Veo eignet sich hervorragend für die Produktion von polierten einzelnen Clips, B-Roll und Kurzvideos, bei denen Bildqualität, Komposition und Seitenverhältnis-Flexibilität wichtig sind

Kling 2.6 (Motion Control)

Gebaut für präzise Bewegungskontrolle und sanfte, konsistente Bewegungen. Kling 2.6 glänzt beim Generieren von realistischen Tanzbewegungen, Kamerabewegungen und wiederholbarem Subjektverhalten — eine starke Wahl, wenn Timing und Choreografie wichtig sind

Seedance 1.8

Optimiert für effiziente Videogenerierung mit Fokus auf Bewegung, Kamerverhalten und stilisierte Ausgaben. Seedance wird häufig für einfachere Szenen, kontrollierte Kamerawinkel und Massenproduktion eingesetzt, wo Geschwindigkeit und Kosteneffizienz Priorität haben

Sora 2

Entwickelt für die komplette Videogenerierung mit starker Szenenkohärenz und natürlicher Bewegung. Sora eignet sich perfekt zum Erstellen längerer Sequenzen und vollständig umgesetzter Videokonzepte, besonders wenn Prompts eine Interpretation oder Erweiterung über mehrere Aufnahmen hinweg erfordern.

Erstellt in Kapwing — von führenden KI-Modellen

-poster.webp)

Bild- und Audiomodelle für jedes Projekt

Kapwing integriert spezialisierte Modelle, die visuelle Inhalte, Sound und Post-Production-Aufgaben unterstützen

ChatGPT Image 2

Wird verwendet, um Bilder von Grund auf zu generieren mit starker Prompt-Interpretation und Anpassung. Entwickelt für textlastige Designs wie Poster, Infografiken, Illustrationen, Lebensläufe und Diagramme, bei denen Layout und lesbarer Text wichtig sind.

Google Nano Banana

Entwickelt zur Bildgenerierung und -bearbeitung mit Kontrolle auf Objektebene. Nano Banana eignet sich perfekt, um einzelne Elemente in einem Bild hinzuzufügen, anzupassen oder zu überlagern, während die visuelle Gesamtkonsistenz erhalten bleibt.

MiniMax 2.5

Generiert benutzerdefinierte Musik, Audiotracks und Soundeffekte zur Verbesserung von Videoinhalten. Speziell entwickelt für Social Media, Musikvideos und kreative Audioexperimente

Seedream 4.5

Optimiert für großflächige Bildtransformation und Neuinterpretation. Seedream eignet sich hervorragend zum Generieren völlig neuer visueller Interpretationen basierend auf bestehenden Konzepten, Stilen oder Quellbildern.

Wie verschiedene KI-Modelle kreative Arbeitsabläufe antreiben

Angewendet bei Ideenfindung, Erstellung und Verbesserung

Kapwing nutzt verschiedene Kategorien von KI-Modellen in unterschiedlichen Phasen des kreativen Prozesses. Jeder Modelltyp wird basierend auf der Art des zu lösenden Problems ausgewählt – ob das die Generierung neuer Inhalte, die Umwandlung bestehender Medien oder das Verstehen von Sprache und Sound ist.

Anstatt sich auf ein einzelnes System zu verlassen, kombiniert Kapwing generative, transformative und verstehende Modelle, um End-to-End-Videoproduktion zu unterstützen und gleichzeitig den Workflow für Creator einfach zu halten.

- Generative Modelle: Werden verwendet, um neue visuelle, Audio- oder Videoinhalte aus Text oder Prompts zu erstellen, einschließlich Videoszenen, Bilder, Musik und Animationen.

- Transformationsmodelle: Werden verwendet, um bestehende Inhalte zu ändern, zu verfeinern oder umzugestalten – wie das Bearbeiten von Video mit Textbefehlen, das Extrahieren von Clips, Audio-Verbesserung, oder Sprachübersetzung.

- Verstehende Modelle: Werden verwendet, um Medien und Sprache zu analysieren und zu interpretieren, was Aufgaben wie Untertitelgenerierung, Dubbing, Lippensynchronisation und Inhaltsstrukturierung ermöglicht.

Häufig gestellte Fragen

Wir haben Antworten auf die häufigsten Fragen, die unsere Nutzer stellen.

Was ist ein AI-Modell?

Ein KI-Modell ist ein trainiertes System, das Muster aus großen Datensätzen lernt, um Inhalte wie Text, Bilder, Audio oder Video zu generieren, zu bearbeiten oder zu analysieren. In Tools wie Kapwing ermöglichen KI-Modelle generative Funktionen, wandeln Eingabeaufforderungen in Videos um, erstellen Bilder, produzieren Voice-Overs und verbessern Medien automatisch.

Welche KI-Modelle unterstützt Kapwing?

Kapwing integriert derzeit neun KI-Modelle für Video-, Bild-, Audio- und Sprach-Workflows. Dazu gehören Modelle für KI-Videogenerierung, Bilderstellung und -bearbeitung, Text-zu-Sprache-Voiceovers, Musik und Soundeffekte sowie strukturierte Textgenerierung. Einzelne KI-Modelle umfassen: Seedream, MiniMax, Google Nano Banana, ChatGPT Image, Wan, Sora, Veo, Kling, und Seedance.

Ist Sora auf Kapwing verfügbar?

Ja, Kapwing integriert derzeit Sora als Teil seiner KI-Video-Workflows. Die Sora Web- und App-Erfahrungen wurden am 26. April 2026 eingestellt. Die in Kapwing integrierte Sora API bleibt bis zum 24. September 2026 verfügbar, was dir ein paar Extra-Monate gibt, um Sora zu nutzen, nachdem die öffentliche Website abgeschaltet wird. Wenn du nach Ersatz-KI-Videoerstellungsmodellen suchst, schau dir unseren Blog über Sora-Alternativen an.

Ist Veo auf Kapwing verfügbar?

Ja, Kapwing integriert Veo als eines der verfügbaren KI-Videomodelle zur Erstellung von Inhalten.

Sind die KI-Modelle kostenlos?

Ja, die meisten Kapwing AI-Modelle kannst du kostenlos ausprobieren. Jedes Modell verbraucht eine unterschiedliche Anzahl von AI-Credits, und einige fortgeschrittene Modelle wie Veo erfordern einen kostenpflichtigen Plan. Mit einem Pro-Upgrade erhältst du mehr Credits, höhere Exportlimits und Zugang zu mehreren AI-Modellen in einem Workspace ohne separate Abos.

Was hat Kapwing's AI Diversity Report über KI-Modelle herausgefunden?

Kapwings AI Diversity Report hat herausgefunden, dass viele KI-generierte Videos Frauen und Menschen of Color unterrepräsentieren und voreingenommene Darstellungen von Rollen und Berufen verstärken können. Die Ergebnisse zeigen branchenweite Herausforderungen in generativer KI und die Bedeutung von Transparenz und laufenden Bemühungen, um Fairness zu verbessern.

Kann ich auswählen, welches AI-Modell Kapwing verwendet?

Ja, wenn du KI-Generierungstools für Bilder, Videos oder Audio verwendest, kannst du auswählen, welches KI-Modell du nutzen möchtest. In anderen Fällen wählt Kapwing automatisch das am besten geeignete KI-Modell basierend auf deiner Aufgabe aus. Das hilft dabei, den kreativen Prozess zu vereinfachen und gleichzeitig optimale Ergebnisse zu liefern.

Wird Kapwing in Zukunft neue AI-Modelle hinzufügen?

Ja. Kapwing bewertet aktiv neue KI-Modelle und integriert sie, während sich die Technologie weiterentwickelt. Dies stellt sicher, dass Creator immer Zugang zu den neuesten Fortschritten bei der Video-, Bild-, Audio- und Sprachgenerierung haben.

Was ist der Unterschied zwischen AI-Modellen und AI-Tools?

AI-Modelle sind die zugrunde liegenden Systeme, die darauf trainiert sind, Inhalte wie Videos, Bilder, Audio oder Text zu generieren, zu analysieren oder zu transformieren. Sie bieten die Kernfunktionalitäten – zum Beispiel AI-Videogenerierung, AI-Bilderstellung oder Sprachsynthese. AI-Tools sind die benutzerfreundlichen Funktionen, die auf diesen Modellen aufgebaut sind. Bei Kapwing kombinieren Tools AI-Modelle mit einem Editor, Steuerelementen und Workflows, damit Creator die Möglichkeiten des Modells einfach nutzen können, ohne direkt mit den Modellen zu interagieren.

Trainiert Kapwing seine eigenen KI-Modelle?

Kapwing integriert hauptsächlich KI-Modelle von Drittanbietern, die von führenden KI-Forschungsorganisationen und Technologieunternehmen entwickelt wurden. Diese Modelle sind in unsere Plattform integriert, um kreative Arbeitsabläufe bei Video-, Bild-, Audio- und Sprachaufgaben zu ermöglichen.

Ist Kling auf Kapwing verfügbar?

Ja, Kapwing integriert Kling 2.6 Motion Control als eines der fortschrittlichen KI-Videomodelle, die in seinen kreativen Arbeitsabläufen verwendet werden.

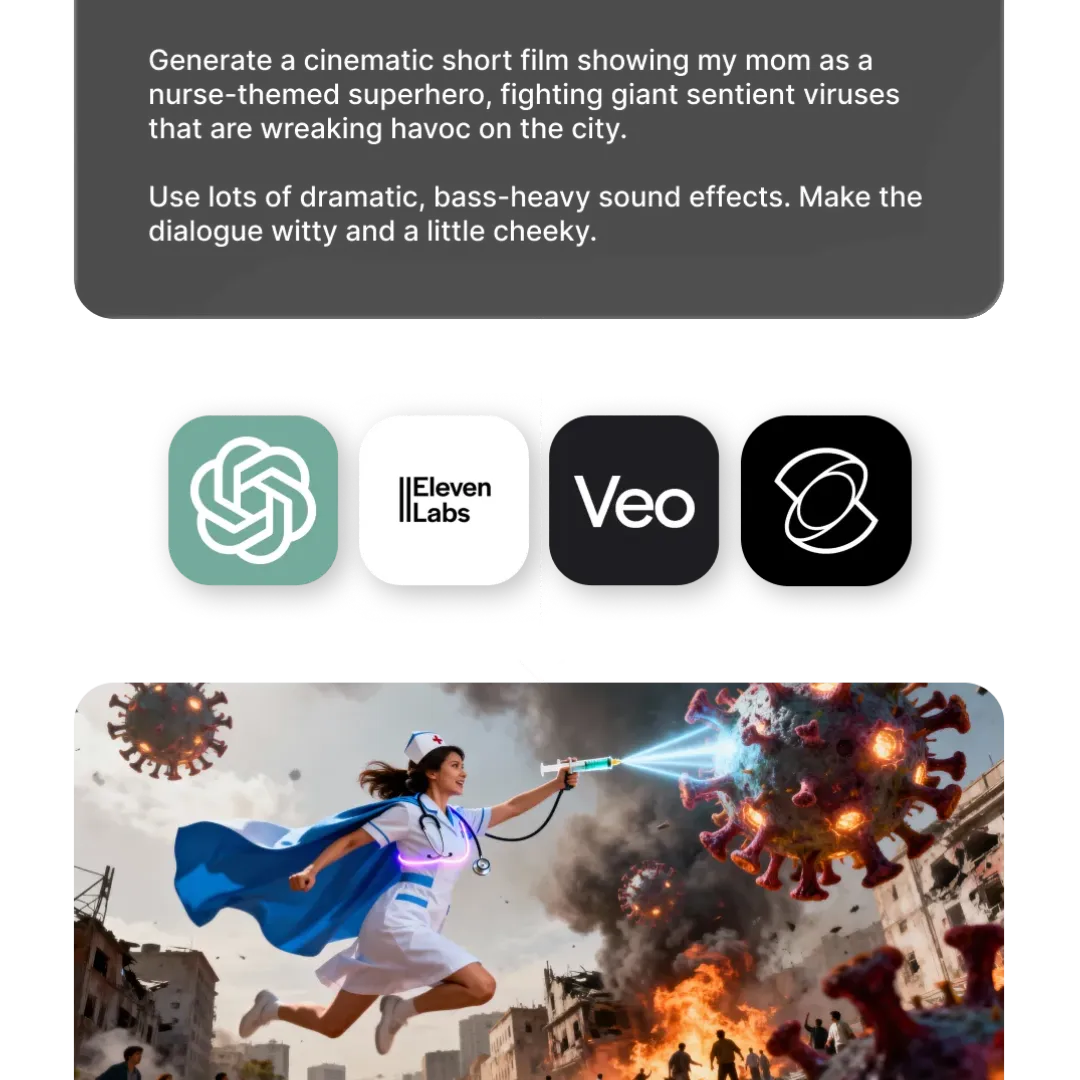

Welches AI-Modell ist am besten zum Erstellen von Kinofilmen geeignet?

Wir empfehlen dir, Sora oder Seedance für die kinematische Videogenerierung in Kapwing zu verwenden. Diese KI-Modelle sind für hochwertige, narrativ geprägte Clips mit sanften Szenenwechseln, natürlichen Bewegungen und realistischen Bildern konzipiert.

Welches KI-Modell ist am besten zum Erstellen von realistischen Tieren geeignet?

Nach Tests von Kapwing produziert Kling 2.6 durchgehend die realistischsten Tiervideos — es punktet bei der Tieranatomie, Oberflächentextur, natürlichen Bewegungen und Umweltinteraktion und schneidet bei Realismus, Bewegung und Szeneneintegration am besten ab

Können KI-Modelle in Kapwing Audio generieren?

Ja, die meisten AI-Videomodelle enthalten Audiogenerierung in Kapwing. Wir empfehlen dir, Veo zu verwenden, um die beste Kontrolle über synchronisierte Umgebungsgeräusche zu haben. Kapwing unterstützt auch dedizierte Audiomodelle wie MiniMax, um benutzerdefinierte Musik und Soundeffekte zu generieren.

Was ist der Unterschied zwischen Sora, Veo, Seedance und Kling?

Kapwing bietet mehrere KI-Modelle, die auf unterschiedliche kreative Anforderungen zugeschnitten sind:

- Sora — Am besten für filmische und narrative Videogenerierung geeignet, mit sanften Szenenwechseln, natürlicher Bewegung und reichhaltigem visuellem Storytelling.

- Veo — Konzentriert sich auf polierte, produktionsreife Clips mit hoher visueller Qualität und integrierter Audiokontrolle, ideal für Markeninhalte oder fertige Inhalte.

- Seedance — Optimiert für effiziente, stilisierte Bewegungen und eine großartige Wahl für schnelle, kreative, sozial fokussierte Videos oder die Generierung großer Mengen.

- Kling — Entwickelt für erweiterte Bewegungskontrolle, sodass du die Bewegung von Objekten und Kamerapfade präzise steuern kannst, um dynamische und actionorientierte Szenen zu erstellen.

Du kannst hier einen vollständigen Vergleichsartikel der KI-Modelle lesen.

Unterstützen Kapwings KI-Modelle Start-Frames, End-Frames und Zeichenkonsistenz?

Ja, Kapwings KI-Modelle unterstützen Multi-Scene-Generierung, Start-Frames, End-Frames und Charakterkonsistenz.

Erstelle dein erstes Video in nur wenigen Klicks. Schließ dich über 35 Millionen Creator an, die Kapwing vertrauen, um mehr Inhalte in weniger Zeit zu erstellen.